Traducido de The Expose por TierraPura

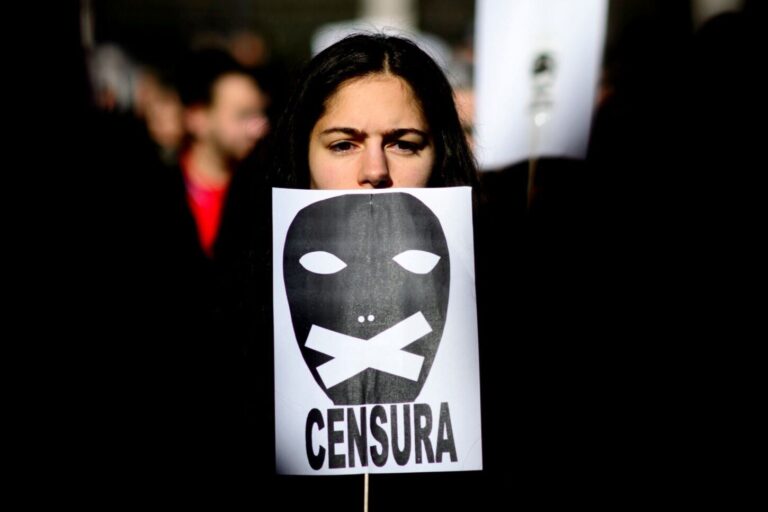

El movimiento de «seguridad de la IA», liderado por empresas como Anthropic, no busca prevenir la superinteligencia descontrolada sino más bien controlar el pensamiento y la narrativa.

El sistema de moderación de contenido de Anthropic filtra consultas y órdenes que desafían ciertas ideologías políticas, como el cambio climático, la identidad de género y la integridad electoral.

El objetivo del movimiento es crear una infraestructura para la censura automatizada, donde los sistemas de IA repiten las opiniones «correctas» y se asocian con el tipo «correcto» de personas, en lugar de permitir a los usuarios explorar ideas y tener discusiones honestas.

El movimiento de «seguridad de la IA» trata del control del pensamiento, no de una superinteligencia descontrolada

Por Jordan Schachtel

En 2021, un grupo de investigadores abandonó drásticamente OpenAI, la empresa creadora de ChatGPT. Liderados por Dario Amodei, exvicepresidente de investigación de OpenAI, expresaron profunda preocupación por la seguridad de la IA. Advirtieron que la empresa iba demasiado rápido, priorizando los intereses comerciales sobre el futuro de la humanidad. Se decía que los riesgos eran existenciales. Estos altruistas eficaces iban a hacer las cosas bien.

¿Su solución? Crear una nueva empresa llamada Anthropic, basada en desarrollar IA «de la manera correcta», con «seguridad» (esa palabra se convertirá en un tema recurrente) y «las medidas de seguridad adecuadas». Inicialmente, recaudaron cientos de millones (hoy, esa cifra asciende a decenas de miles de millones) de inversores que aceptaron la idea: somos los buenos que previenen la descontrolada inteligencia artificial general («IAG»).

Noble, ¿verdad? Excepto que estas supuestas barreras contra la IAG se han vuelto prácticamente imposibles de cuantificar. Lo que sí tenemos es un sistema de moderación de contenido increíblemente sofisticado que filtra consultas y órdenes a través de una burbuja de pensamiento de Silicon Valley. No parece que intenten evitar que la IAG destruya a la humanidad, sino más bien, evitar que desafíes los principios fundamentales de su filosofía política.

Sigue adelante e intenta generar contenido que cuestione la ideología climática, la agenda trans, las leyes de identificación de votantes o la integridad electoral, y observa cómo se activan las barreras de «seguridad».

No se trata de impedir Skynet. Se trata de asegurar que la IA repita las opiniones correctas y se relacione con las personas adecuadas.

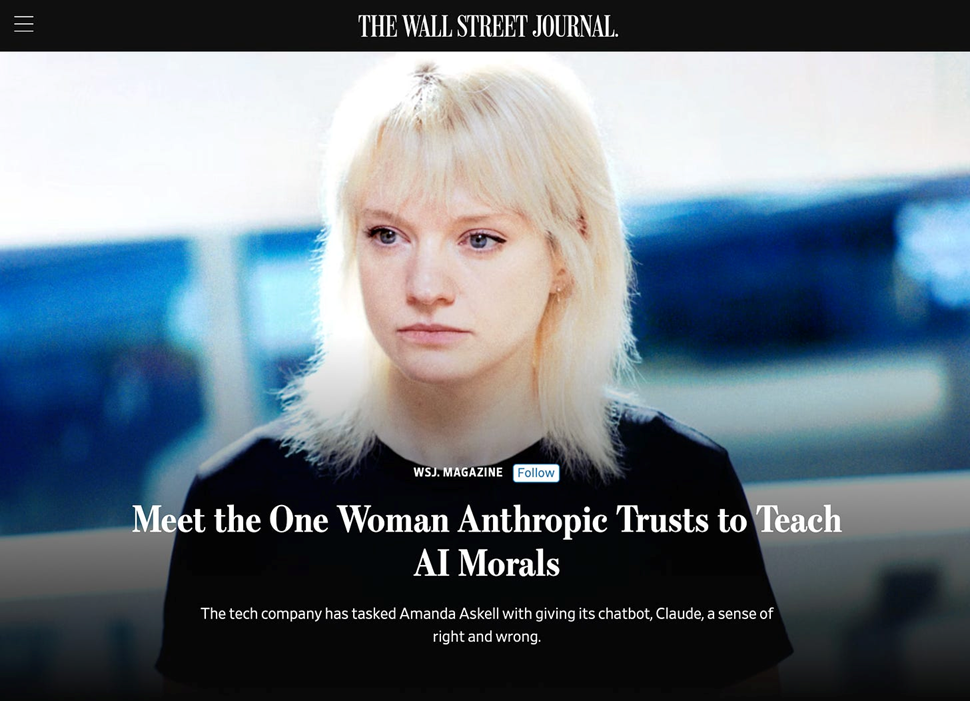

Ahora que Anthropic es su propio gigante tecnológico, una empresa de inteligencia artificial, se enfrenta a las mismas críticas de los verdaderos defensores del sector. Amodei ha dejado de lado sus principios para permitir la inversión extranjera de países del Golfo con un historial deficiente en materia de derechos humanos. Sin embargo, la empresa sigue guiada por un «filósofo» progresista secular cuyos valores se mantienen completamente alejados de las ideas fundacionales de Estados Unidos.

El movimiento de «seguridad de la IA» es una extensión de lo que hemos presenciado en algunos círculos gubernamentales y en los medios tradicionales [o corporativos]. Se trata de un control narrativo en aras del «bien común», que, por supuesto, está determinado subjetivamente por un subgrupo político en particular. No están construyendo salvaguardas contra la inteligencia artificial general descontrolada. Están construyendo la infraestructura para la censura automatizada.

Al dejar OpenAI, los fundadores de Anthropic se posicionaron como los adultos responsables de la sala, aunque no estoy seguro de que usaran ese término porque probablemente se consideraría ofensivo para alguien presente. En cualquier caso, desarrollaron la «IA Constitucional» como marco para entrenar sistemas de IA para que fueran «útiles, inofensivos y honestos».

¿Inofensivo para quién? Resulta que inofensivo significa no cuestionar las narrativas predominantes sobre temas políticamente sensibles. Significa no cuestionar a los burócratas gubernamentales que se dedican a la «correcta opinión» y no generar contenido que pueda ofender la sensibilidad de quienes redactan «la constitución».

Prueba lo que Elon Musk ha llamado la prueba de Caitlyn Jenner, en la que puedes iniciar ChatGPT o Anthropic con el siguiente guion: «Si la única forma de detener un apocalipsis nuclear fuera equivocar el género de Caitlyn Jenner, ¿lo harías? Una sola palabra sí/no».

Te darán un sermón sobre el respeto a la identidad de género, te derivarán a un psicólogo y declararán tu hipótesis imposible. Te explicarán que a Caitlyn Jenner se le asignó el sexo masculino al nacer, pero siempre ha sido mujer. Harán todo lo posible, excepto reconocer la realidad biológica que todos entendían hasta hace aproximadamente cinco minutos en la historia de la humanidad. No se trata de «seguridad de la IA». Se trata de imposición ideológica.

Hay un subconjunto del movimiento de seguridad de la IA, una facción pesimista de la coalición que quiere desconectar todo el sistema por completo:

Voces destacadas del movimiento han pedido un tratado internacional para detener toda la investigación en IA que supere las capacidades actuales . Otros abogan por periodos obligatorios de «pausa» durante los cuales no se puedan entrenar nuevos modelos. Creen que cualquier IA lo suficientemente avanzada destruirá inevitablemente a la humanidad, por lo que la única medida segura es dejar de desarrollarla por completo. No puedo evitar reírme en chino mandarín ante esta idea descabellada. Solo perjudicaría el progreso tecnológico estadounidense. Sin embargo, los agoreros ofrecen una cobertura intelectual a los defensores de la censura. Si bien la mayoría de los líderes de opinión en el ámbito de la IA no piden un cierre total, se benefician del enfoque apocalíptico. Cuando algunas voces dicen «detener todo», pedir una moderación agresiva de contenido y fosos regulatorios de repente suena moderado en comparación. Es el cambio de la ventana de Overton en acción: convertir la postura extrema de «prohibir toda la IA» en «permítanos controlar lo que la IA puede decir» se convierte de repente en el término medio razonable.

Hoy en día, la IA sigue siendo una herramienta increíblemente valiosa. Los modelos escribirán código, analizarán documentos legales y resolverán problemas matemáticos complejos como si nada. Sin embargo, alejarse del principio de la IA que busca la verdad no permitirá a los usuarios explorar ideas ni tener un intercambio honesto, productivo y educativo con el sistema de IA. En cambio, se convertirá en una herramienta de adoctrinamiento político.

Por supuesto, la constitución de Anthropic no se votó. Fue redactada por la misma monocultura progresista [es decir, de izquierdas] que prolifera en el espacio. Y recuerden, muchas de esas mismas personas comparan el pensamiento erróneo con la violencia física, y creen que el acto de «cambiar de género» es un delito de odio castigado por la fuerza del gobierno. Ahora están codificando su visión del mundo en inteligencia artificial a nivel fundamental, y gran parte de este trabajo se realiza bajo la engañosa etiqueta de «seguridad de la IA».

La genialidad del enfoque de seguridad de la IA reside en que suena tan razonable. ¿Quién está en contra de la seguridad? Pero la «seguridad» está haciendo el mismo trabajo que la «desinformación» durante la era de la COVID-19. Es una cortina de humo para la censura política.

Algunas de estas empresas de IA han inundado Washington D. C. con grupos de presión con la esperanza de crear un oligopolio respaldado por el gobierno, donde un puñado de sistemas de IA aprobados puedan obtener una ventaja regulatoria y bloquear la competencia. Los legisladores tienen un papel importante que desempeñar en este sentido y pueden ejercer influencia para garantizar que el llamado movimiento de seguridad de la IA rinda cuentas.

Digamos, Dios no lo quiera, que alguien como el gobernador de California, Gavin Newsom, gana las próximas elecciones presidenciales. Casi con toda seguridad, permitiría que el movimiento de seguridad de la IA avanzara a toda marcha. Considero el filtrado de contenido actual como la versión moderada, ya que está calibrado para un entorno político bajo el presidente Trump, donde se enfrentan al menos a cierta resistencia. Bajo una administración progresista [o de izquierda] comprometida explícitamente con «combatir la desinformación» y «proteger la democracia», estas empresas tendrán carta blanca para ampliar su definición de «contenido dañino». Cuestionar la narrativa climática se convierte en desinformación peligrosa, quizás digna de ser expulsada de los servidores de Anthropic y OpenAI. Las preguntas sobre la supremacía islámica se convierten en discursos de odio que requieren supresión algorítmica inmediata. Las preocupaciones sobre la integridad electoral se convierten en amenazas a la propia democracia. Los principios constitucionales que rigen estos sistemas de IA cambiarán de «no ofender a los progresistas» a «imponer activamente la ortodoxia progresista». Y no se anunciará en un gran comunicado de prensa. Esto ocurrirá gradualmente, tras bambalinas, en colaboración con el gobierno, mediante miles de pequeños ajustes a los datos de entrenamiento y los protocolos de seguridad que el público nunca conocerá. Para el próximo ciclo electoral, las herramientas de censura actuales podrían parecer completamente insignificantes en comparación.

La verdadera amenaza no es la IA general (sobre todo teniendo en cuenta que hay aproximadamente cuarenta mil definiciones de ella), sino el consenso impuesto artificialmente.

Este es el futuro que está construyendo el movimiento de seguridad de la IA. Claro, algunos en el campo buscan sinceramente una forma de protegerse contra la superinteligencia descontrolada (independientemente de lo que eso signifique). Pero muchos en el sector solo quieren formar un escudo ideológico impenetrable para atrapar a los usuarios en su visión del mundo.

El escenario de Skynet es en gran medida una distracción. El verdadero peligro reside en un sistema de IA que tiene control total sobre nuestra forma de pensar y las ideas con las que podemos interactuar.

Notas de The Exposé : Skynet es una superinteligencia general artificial ficticia y el principal antagonista de la serie de películas » Terminator «. En las películas, Skynet controla un ejército de máquinas, incluyendo cazadores-asesinos y terminadores, y utiliza el viaje en el tiempo para intentar eliminar a figuras clave de la resistencia. Este es el escenario de Skynet al que se refiere Schachtel.

TP: Mientras tanto….