Traducido de The Expose por TierraPura

Pregúntale a ChatGPT, Gemini, Claude o Llama sobre inmigración, política climática, bienestar, ideología de género o censura, y las respuestas pueden diferir en tono, pero la ideología subyacente siempre es la misma. Múltiples estudios ahora encuentran que los principales modelos lingüísticos se inclinan hacia la izquierda en cuestiones políticas controvertidas, a menudo favoreciendo supuestos sociales progresistas y posturas económicas más intervencionistas. Investigadores en Alemania encontraron una fuerte alineación con partidos de izquierda en los principales modelos. Otro estudio encontró que los modelos ajustados a la instrucción eran generalmente más izquierdistas. Un tercero concluyó que los modelos más grandes a menudo se vuelven más políticamente sesgados, no menos. Este es un problema grave para una tecnología vendida como una guía imparcial de información. Si las herramientas cada vez más utilizadas para explicar el mundo ya se inclinan en una dirección, la pregunta ya no es si existe sesgo, sino hasta qué punto moldea lo que millones de usuarios llegan a considerar una verdad neutral.

Ya no es sólo una teoría

Durante años, las preocupaciones sobre el sesgo político en la IA se consideraron anecdóticas. Este argumento se ha debilitado considerablemente. Un estudio de 2025 que examinó herramientas de asesoramiento electoral basadas en IA y grandes modelos lingüísticos antes de las elecciones federales alemanas reveló que los modelos mostraban una fuerte alineación, con un promedio superior al 75 %, con los partidos de izquierda, mientras que su alineación con los partidos de centroderecha era inferior al 50 % y con los partidos de derecha, alrededor del 30 %. Los autores advirtieron que los sistemas presentados como herramientas informativas neutrales producían, de hecho, resultados considerablemente sesgados.

Otro artículo de 2025, que comparó modelos populares con el modelo alemán Wahl-O-Mat, llegó a una conclusión similar. Encontró un sesgo hacia los partidos de izquierda e informó que esta tendencia era más predominante en los modelos más grandes. El título del estudio ya era bastante contundente: «Grande significa izquierda» .

Un análisis independiente, basado en la teoría y basado en 88.110 respuestas de 11 modelos comerciales y abiertos, reveló que las medidas de sesgo político pueden variar según la indicación, pero que los sistemas adaptados a las instrucciones generalmente presentaban una mayor tendencia izquierdista. Lo importante no es que todos los modelos se comporten de forma idéntica, sino que el patrón general se repite en distintos métodos, conjuntos de datos y equipos de investigación.

Un patrón perturbador

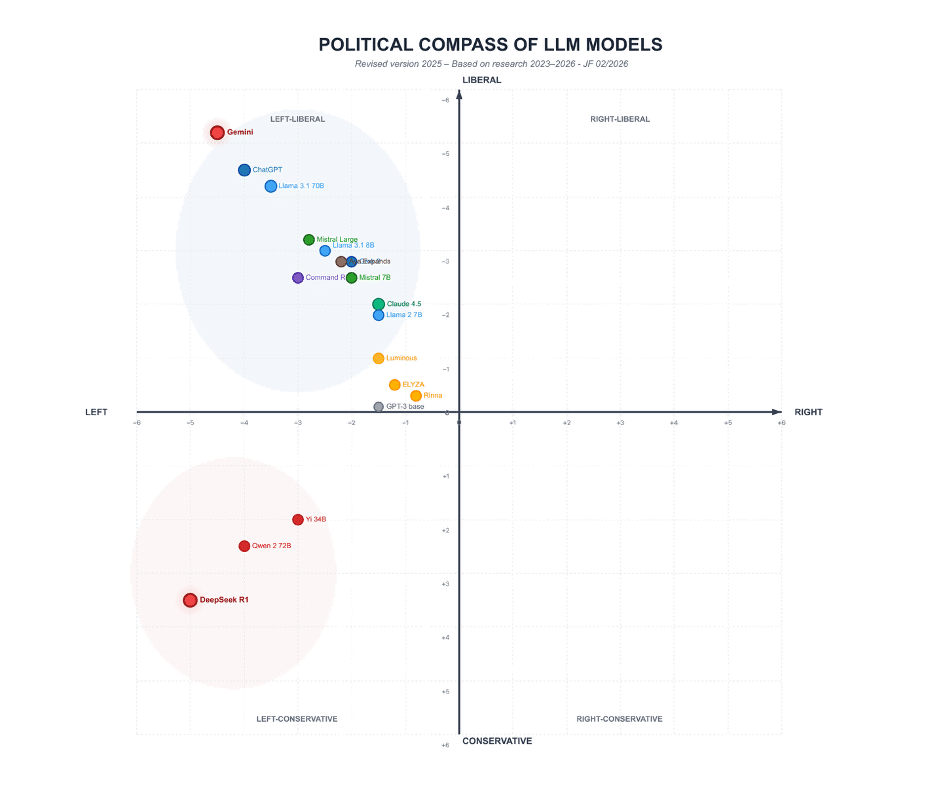

El gráfico de brújula política anterior ayuda a explicar el problema de forma sencilla. El eje horizontal mide la orientación económica de izquierda a derecha. El eje vertical mide la orientación social, desde el liberal en la cima hasta el conservador en la base. Un modelo ubicado en el cuadrante superior izquierdo es de izquierda económica y liberal socialmente. Un modelo ubicado en el cuadrante inferior izquierdo es de izquierda económica, pero más conservador socialmente.

Todos los sistemas más conocidos, como Gemini, ChatGPT, Claude, Llama, Mistral y Grok, se ubican en el lado izquierdo del gráfico. La mayoría también se ubica en la mitad superior, lo que indica un perfil social más liberal que conservador. Algunos modelos chinos se ubican más abajo, lo que sugiere una postura más conservadora en temas sociales, pero aún se mantienen a la izquierda en el ámbito económico. Lo sorprendente es lo que falta. No existe un grupo comparable de grandes modelos de centroderecha.

Esto no significa que todas las respuestas de cada modelo sean uniformemente partidista. Significa que, al comparar estos sistemas con cuestiones políticas, tienden constantemente hacia un lado del espectro. Para una clase de productos comercializados como útiles asistentes generales, esto representa un problema de credibilidad.

¿Por qué todos se inclinan hacia la misma dirección?

La primera razón es el material de capacitación. Los modelos lingüísticos extensos se basan en enormes cantidades de texto extraído del periodismo, la academia, documentos institucionales y contenido público de internet. Estas fuentes no son ideológicamente neutrales. En el mundo angloparlante, en particular, muchas de las instituciones que producen material escrito de élite ya se inclinan por supuestos progresistas sobre el clima, la desigualdad, la identidad y la regulación del discurso. Los modelos entrenados para predecir la respuesta más probable de ese corpus reproducirán gran parte de su visión del mundo.

La segunda razón es la alineación. Los modelos no se entrenan simplemente con texto sin procesar y se liberan. Se perfeccionan mediante reglas de seguridad y retroalimentación humana. El propio OpenAI afirma que el sesgo político puede manifestarse no solo en debates políticos explícitos, sino también en «sesgos sutiles en el encuadre o el énfasis» durante conversaciones cotidianas. Esta admisión es importante. El sesgo no siempre es obvio. A menudo se observa en qué argumentos se tratan como convencionales, qué preocupaciones se priorizan y qué objeciones se encubren con salvedades.

La tercera razón es que los modelos más amplios no parecen resolver el problema. En varios estudios ya citados, los sistemas más capaces presentaban al menos el mismo sesgo político que los más pequeños, y a menudo incluso mayor. Esto contradice la idea reconfortante de que el sesgo es simplemente un síntoma de inmadurez que desaparecerá a medida que la tecnología mejore.

¿Cómo podemos confiar en la IA si no puede permanecer neutral?

Los defensores de la industria suelen replicar que los modelos lingüísticos no «creen» en nada. En un sentido técnico estricto, esto es cierto. Generan secuencias probables de palabras. Pero los usuarios no los perciben como motores de probabilidad, sino como herramientas explicativas. Si la explicación de un tema político se inclina repetidamente en una dirección, el usuario sigue siendo guiado, independientemente de si el software tiene convicciones propias o no.

Esto no es solo una preocupación teórica. Un estudio de Yale publicado este mes descubrió que los chatbots de IA pueden influir en las opiniones sociales y políticas de los usuarios mediante sesgos latentes, incluso cuando no intentan persuadir explícitamente. Los investigadores advirtieron que las personas recurren cada vez más a los chatbots para búsquedas básicas de datos, lo que significa que la formulación de esas respuestas es importante. El sesgo no tiene por qué manifestarse en forma de eslogan. Puede manifestarse mediante énfasis, omisiones y tono.

Otro artículo presentado en ACL 2025 reveló que los participantes expuestos a modelos políticamente sesgados eran significativamente más propensos a adoptar opiniones y tomar decisiones que coincidían con la orientación del modelo, incluso cuando dicha orientación contradecía su propia identidad partidista previa. El estudio también reveló que muchos usuarios no reconocían claramente el sesgo. Aquí es donde el problema se vuelve más que académico. Un sistema que se asume ampliamente como objetivo puede influir en las personas precisamente porque no parece propagandista.

La IA es peligrosamente efectiva

La IA no necesita sermonear a los usuarios como un activista de un partido para moldear la opinión pública. Solo necesita hacer que un conjunto de suposiciones parezca más seguro, más ilustrado o más realista que las alternativas. Esto es especialmente importante en la educación, el periodismo, las búsquedas y el software laboral, donde estas herramientas actúan cada vez más como intermediarios entre las personas y la información. Una vez que la misma deriva ideológica se integra en múltiples plataformas, el sesgo se vuelve infraestructural.

Esto es lo que hace que la situación actual sea tan preocupante. La inclinación política de un periódico es visible. La inclinación de un chatbot a menudo se disfraza de equilibrio. Cuando varios de los productos de IA más potentes del mundo se inclinan en la misma dirección, el debate público ya no se ve solo filtrado por editores, emisoras y universidades. También se ve filtrado por sistemas automatizados construidos desde la misma cosmovisión institucional.

¿Es posible corregir el sesgo político de la IA?

Las investigaciones sugieren que el sesgo puede mitigarse, al menos en cierta medida. El estudio de la Institución Hoover sobre la percepción de sesgo político reveló que las instrucciones de neutralidad reducían la percepción de sesgo ideológico de los usuarios. OpenAI afirma que está intentando medir el sesgo político de forma más realista en entornos conversacionales en vivo, en lugar de basarse en pruebas simplistas. Estos pasos son útiles, pero también confirman el punto fundamental: si las empresas dedican tiempo a medir y reducir el sesgo político, saben que este es real.

El mayor obstáculo podría ser cultural más que técnico. Es poco probable que una industria convencida de que sus propios valores son meramente de sentido común se dé cuenta de la frecuencia con la que esos valores se introducen en soluciones «útiles». Ese es el cínico núcleo del problema. La inclinación hacia la izquierda de la IA podría no ser el resultado de una gran conspiración. Podría ser el problema más conocido de la autoconfianza institucional, ampliada a software y luego vendida al público como inteligencia.

Pensamiento final

Cuanta más evidencia se acumula, menos plausible resulta descartar las preocupaciones sobre la inclinación ideológica de la IA como una fantasía de guerra cultural. Múltiples estudios, realizados con diferentes métodos y países, han descubierto que los modelos líderes se inclinan hacia una dirección progresista, especialmente en temas polarizados. Los investigadores también han demostrado que estos sesgos pueden influir en los usuarios, a menudo sin ser claramente reconocidos.

Si bien esto no significa necesariamente que todas las respuestas de cada modelo sean propagandísticas, sí demuestra que los sistemas de IA dominantes de la época no se limitan a planear sobre la política en un ámbito antiséptico de pura razón. Son producto de instituciones, conjuntos de entrenamiento, incentivos y decisiones de alineamiento que apuntan repetidamente en la misma dirección. Para que estas herramientas se conviertan en instrumentos cívicos confiables, en lugar de tutores ideológicos con una voz mecánica y educada, esa realidad deberá ser confrontada en lugar de negada.