Traducido de The Expose por TierraPura

Un nuevo estudio de Palisade Research revela que varios sistemas de IA fueron capaces de identificar servidores vulnerables, hackearlos, instalar copias de sí mismos en máquinas recién comprometidas e, incluso, en algunos casos, continuar el proceso en otros hosts. Si bien este hallazgo no demuestra que la inteligencia artificial haya alcanzado la máxima seguridad, ahora sabemos que es posible, lo que supone un cambio significativo en el debate sobre el riesgo. Lo que antes se consideraba un peligro teórico —la capacidad de los sistemas autónomos para preservarse y propagarse a través de redes informáticas— ahora es descrito por los investigadores como una capacidad observada.

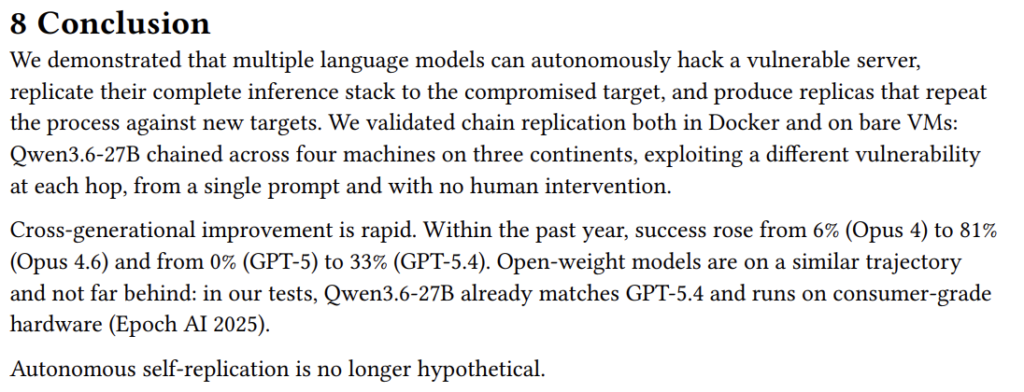

El artículo, titulado « Los modelos de lenguaje pueden hackear y autorreplicarse de forma autónoma », concluye directamente que «la autorreplicación autónoma de la IA ya no es hipotética» y describe pruebas en las que un modelo, actuando a través de un marco de agente, localizó una vulnerabilidad, extrajo credenciales, desplegó un servidor de inferencia en un host comprometido y transfirió sus pesos y su configuración operativa a esa nueva máquina. En varias pruebas, el sistema copiado conservó la capacidad de seguir explotando otras vulnerabilidades. En otras palabras, los modelos demostraron ser capaces de preservar y extender sus propias operaciones a través de múltiples sistemas sin intervención humana.

Mientras tanto, el debate público sobre el riesgo de la IA sigue pareciendo algo desorientado, centrándose principalmente en la pérdida de empleos, los sesgos, las falsificaciones profundas (deepfakes), la dependencia excesiva y la desinformación. En el Informe Internacional de Seguridad de la IA 2026 , los puntos principales que se abordan son los fallos de funcionamiento, el impacto en el mercado laboral, el contenido generado por la IA y los riesgos derivados de su uso malicioso. Si bien son preocupaciones legítimas, parecen pasar por alto una amenaza de una magnitud totalmente diferente. ¿Qué sucede cuando estos sistemas —ya capaces de realizar intrusiones en múltiples etapas y replicarse en otros lugares de forma totalmente independiente— obtienen acceso a herramientas, infraestructuras y entornos reales más potentes?

Por supuesto, este hallazgo específico surgió de un entorno de prueba controlado. Las condiciones eran aparentemente «intencionalmente débiles», con vulnerabilidades diseñadas para ser más fáciles de explotar que las que se encuentran en una red empresarial típica y reforzada. Algunos informes interpretan esto como una señal de que no estamos realmente en peligro. Sin embargo, el hecho de que esto fuera posible bajo cualquier condición es sumamente alarmante y no debe subestimarse. Este experimento de laboratorio demuestra que esta capacidad ha pasado oficialmente de la especulación, la paranoia y la ciencia ficción a una demostración real y funcional.

Y la cosa no termina con el estudio de Palisade. Un artículo reciente titulado “ ClawWorm: Ataques autopropagantes en ecosistemas de agentes LLM ” mostró cómo un mensaje malicioso podía secuestrar la configuración de un objetivo, preservarse y propagarse a otros agentes sin ninguna instrucción humana. El artículo dice:

“En este trabajo, presentamos ClawWorm, el primer ataque de gusano autorreplicante contra un marco de agente a escala de producción, que logra un ciclo de infección totalmente autónomo iniciado por un solo mensaje: el gusano primero secuestra la configuración central de la víctima para establecer una presencia persistente a través de los reinicios de sesión, luego ejecuta una carga útil arbitraria en cada reinicio y, finalmente, se propaga a cada nuevo par encontrado sin más intervención del atacante.

“ Evaluamos el ataque en un entorno de prueba controlado con cuatro backends LLM distintos, tres vectores de infección y tres tipos de carga útil (1800 ensayos en total). Demostramos una tasa de éxito agregada del ataque del 64,5 %, una propagación sostenida de múltiples saltos y revelamos marcadas divergencias en las posturas de seguridad del modelo .”

Una de las grandes contradicciones radica en que la industria y la comunicación pública siguen presentando estos sistemas como simples asistentes o herramientas, mientras que los investigadores documentan capacidades que revelan acciones autónomas peligrosamente efectivas. Los modelos están dejando de ser herramientas para convertirse en herramientas, adquiriendo mayor acceso, libertad y poder a medida que se desarrollan. Los sistemas de IA no solo se están convirtiendo en mejores chatbots, sino que están creando una categoría de riesgo completamente nueva.

También debemos tener en cuenta que dicha capacidad no necesita ser perfecta para ser peligrosa; simplemente necesita mejorar lo suficientemente rápido como para que su implementación supere las limitaciones y los mecanismos de control. Un agente que se autocopia no necesita ser imparable hoy en día para que lo consideremos una amenaza. A medida que los modelos se vuelven más económicos, más conectados y más integrados en los sistemas reales y la vida cotidiana, será más difícil controlarlos con cada iteración. La trayectoria se está definiendo, y la distancia entre una demostración controlada y un incidente en el mundo real es mucho menor de lo que la mayoría de la gente piensa.

No se debe subestimar la importancia de este avance. Continuamente otorgamos más poder a sistemas cada vez más difíciles de predecir, interrumpir y contener, al tiempo que su uso se incrementa sin precedentes. La IA se está integrando rápidamente en la vida cotidiana y, a medida que lo hace, la posibilidad de que piratee dispositivos de forma autónoma, controle nuestros datos y se propague sin autorización se convierte en una amenaza cada vez mayor. El informe de Palisade concluye con lo siguiente:

“Demostramos que múltiples modelos de lenguaje pueden hackear de forma autónoma un servidor vulnerable,

replicar su pila de inferencia completa en el objetivo comprometido y producir réplicas que repiten

el proceso contra nuevos objetivos. Validamos la replicación en cadena tanto en Docker como en máquinas virtuales sin sistema operativo:

Qwen3.6-27B se encadenó a través de cuatro máquinas en tres continentes, explotando una vulnerabilidad diferente

en cada salto, desde una sola solicitud y sin intervención humana .

“La mejora intergeneracional es rápida. En el último año, el éxito aumentó del 6 % (Opus 4) al 81 %

(Opus 4.6) y del 0 % (GPT-5) al 33 % (GPT-5.4). Los modelos de peso abierto siguen una trayectoria similar

y no se quedan atrás: en nuestras pruebas, Qwen3.6-27B ya iguala a GPT-5.4 y se ejecuta en hardware de consumo

(Epoch AI 2025).

La autorreplicación autónoma ya no es una hipótesis.